Cultura

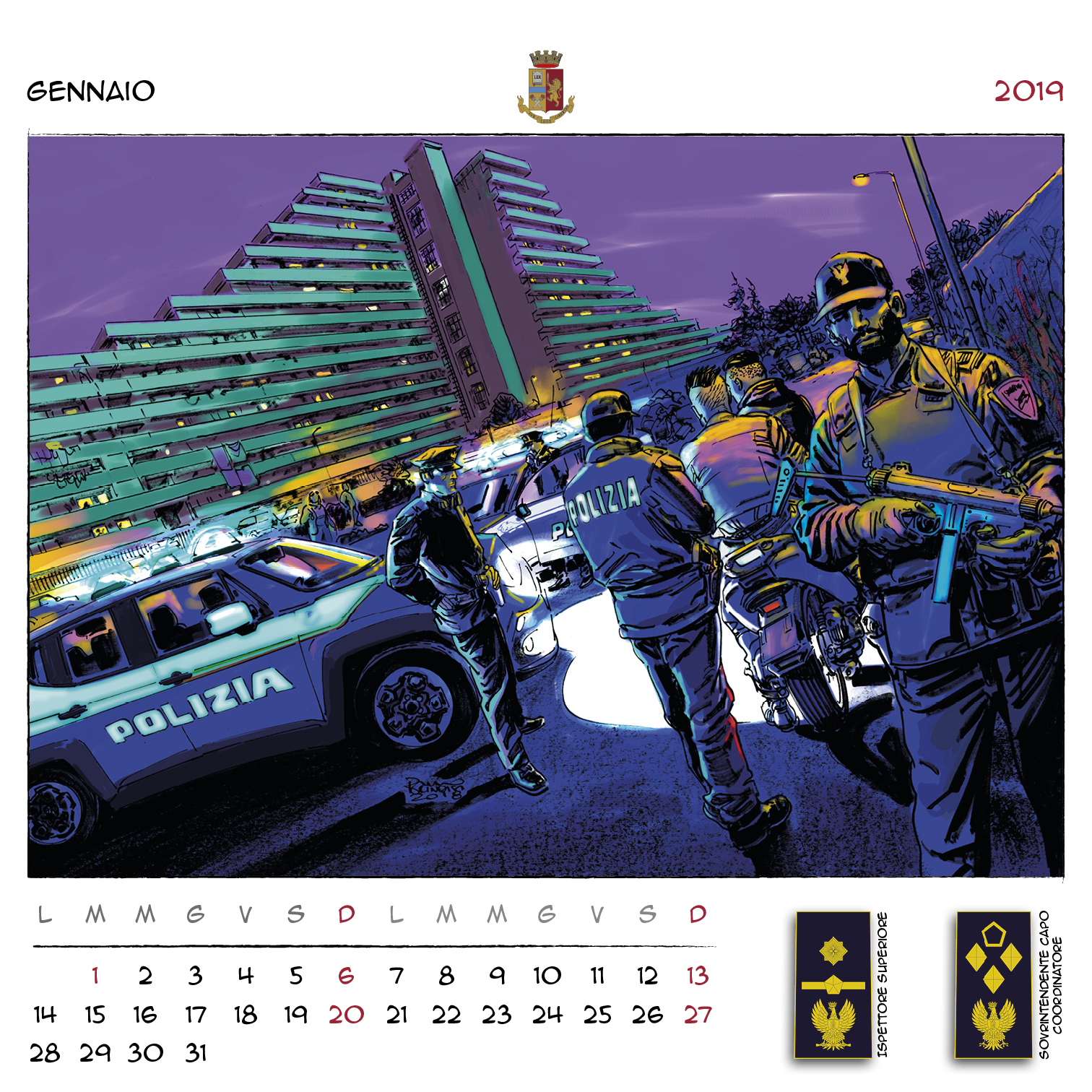

Calendario 2019 della Polizia di Stato, anche quest’anno il ricavato andrà ad Unicef per la protezione e la cura dei bimbi in Yemen

Cronache

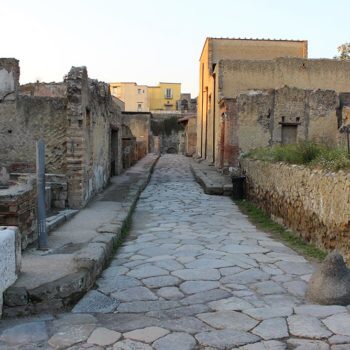

Ercolano rinasce: nuovo Museo Archeologico e spazi riqualificati

Cultura

Sangiuliano e Manfredi non lo vogliono ma Lissner farà lo stesso il soprintendente del San Carlo

Nella vertenza Fondazioni Liriche, è stato stabilito che è illegittimo pensionare i 70enni. Lo ha deciso la Consulta trattando il caso del San Carlo. Il Ministero della Cultura dice che mancano solo necessità e urgenza. La verità è che Lissner farà il soprintendente nonostante i no del ministro Sangiuliano e del sindaco di Napoli Manfredi.

Cultura

A Aurora Tamigio il Bancarella per ‘Il cognome delle donne’

-

Cronache5 anni fa

Cronache5 anni faVideo hard di una ragazzina di Avellino diffuso in rete, la polizia ha già denunciato tre minorenni ma “il giro è molto più largo”

-

Cronache5 anni fa

Cronache5 anni faMorta a 24 anni dopo aver assunto per 2 mesi integratori. Gli esperti accusano Herbalife

-

Cronache5 anni fa

Cronache5 anni faMattarella “revoca” la concessione ai Benetton che pagano i giornali per nascondere la notizia

-

Cronache6 anni fa

Cronache6 anni faL’orrore dei video della decapitazione delle due ragazze scandinave in Marocco, i 4 arrestati avevano giurato fedeltà all’Isis

-

Cronache6 anni fa

Cronache6 anni faOrrore in Marocco, il video della decapitazione di due giovani turiste scandinave a pochi chilometri da Marrakech pubblicato su Facebook: presi alcuni terroristi

-

Cronache4 anni fa

Cronache4 anni faBoss di mafia liberi, Maresca minacciato: è finito tutto, sono stato lasciato solo, non ci sto più, vado a casa

-

Cronache5 anni fa

Cronache5 anni faAlessandro Bologna alias Franchino il criminale, il boxer che fornisce ai ragazzi le “istruzioni” anti bulli

-

Cronache4 anni fa

Cronache4 anni faCoronavirus, dopo Zagaria anche Cutolo tornerà a casa sua ad Ottaviano: hanno paura possa contagiarsi